Mythbusters: drie mythes omtrent A/B-testen

A/B-testen is een veelgebruikte methode om verschillende varianten van dezelfde pagina’s te testen. De tests worden ingezet met verschillende doeleinden, bijvoorbeeld om online service te optimaliseren of om conversie te vergroten. Er bestaan verschillende mythes rond A/B-testen. Hoog tijd om er een paar te onderwerpen aan een kritische blik.

Mythe: een A/B-test kun je beperkt inzetten

Een A/B test kan je doen om heel veel verschillende redenen. Zo kun je bekijken welke banner het beste converteert, wat voor lettertype, wat voor kleur en tekst je je call to action buttons het beste kunt geven… De mogelijkheden zijn eindeloos.

En je bent nooit klaar: ook al converteert een salesbanner het beste op een bepaalde plek op pagina A . Dan nog betekent dat niet dat dit hetzelfde is op pagina B. En: misschien converteert een bepaalde tekst in een button nu goed op de ene manier, maar doet een andere manier het over een tijdje weer beter. Er zijn wel richtlijnen voor (zo converteren salesbanners met een duidelijke call to action beter dan met een algemene tekst) maar als je echt wil weten wat voor jouw site de beste oplossing is, is zelf testen nog altijd de beste optie.

Wel moet je er zelf altijd goed bij stilstaan wat je test en waarom. Zelfs als één design wint, betekent dit niet dat je deze klakkeloos overal kunt toepassen. Andere pagina’s hebben immers niet dezelfde rol in de customer journey. En natuurlijk kan het dat een product goed verkoopt als deze gepromoot wordt, maar heeft dit ook gevolgen voor de andere producten in je webwinkel?

Kortom: ja, A/B-testen heeft veel voordelen en als webredacteur is de test breed inzetbaar. Pas echter op dat je niet in de clinch komt met je sales-afdeling, en stem van tevoren goed af wat het beoogde resultaat is en of dat –ook als één versie beter converteert- overeenkomt met het doel van de pagina.

Mythe: A/B-testen is slecht voor je conversie

Gezegd wordt dat het uitvoeren van A/B-testen slecht kan zijn voor je conversie en dat je beter gebruik kunt maken van zelflerende optimalisatie. Dat is een vorm van optimalisatie waarbij de schijnbaar winnende variant al snel vaker getoond wordt dan de andere versie. Dit in plaats van de hele test af te wachten.

Dit gaat lang niet altijd op. Vergeet niet dat een A/B-test niet een setting is die je doet onder gecontroleerde omstandigheden in een laboratorium. Nee, je doet een onderzoek onder willekeurige bezoekers van je website. Dit leidt ertoe dat het in eerste instantie, na het starten van je test, kan lijken dat één van beide versies sterker converteert. Dit kan in dat stadium echter nog volkomen toevallig zijn.

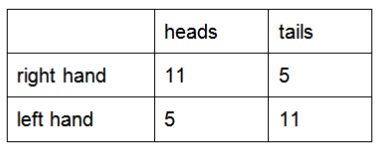

Bekijk het namelijk maar eens zo: stel, je hebt twee muntjes. Eén in elke hand. Je onderzoekt of je linker- of rechterhand beter is in het gooien van kop of munt. Je gooit het muntje. De uitslag die je dan kan krijgen is de volgende:

We weten dat het niet aan de muntjes ligt, en dat de kans dat je kop dan wel munt gooit altijd 50% is. Echter, als we een t-test doen om te berekenen hoe zeker we kunnen zijn van het resultaat, zien we dat de rechterhand 96.6% beter is in het gooien van ‘kop’. Dit kan natuurlijk niet (Een uitgebreidere uitleg lees je hier).

Was dit een A/B-test geweest, hadden we de ‘rechterhand’ variant gebruikt. Dit was niet erg geweest, maar had ook niks opgeleverd. Dit kan echter ook gebeuren met een slechtere variant, waarna je conversie uiteindelijk omlaag gaat. Vertrouw dus niet op je initiële resultaten, maar wacht tot je hele A/B-test gedaan is. Het is immers van belang dat je voldoende bezoekers hebt op je pagina voor je een conclusie durft te trekken.

Voorstanders van zelflerende optimalisatie geven aan dat het zonde is niet in te gaan op de best converterende versie, omdat één van beide versies slechter presteert dan de ander. Veel tests verlopen echter aanvankelijk grillig, en vertonen pas bij voldoende volume (en tijd) een duidelijke trend.

Myhte:

(Maar je moet wel je hele test voltooien.)

Mythe: alleen grote bedrijven kunnen A/B-testen inzetten

Kun je een A/B-test dan alleen uitvoeren als je voor een groot bedrijf werkt? Nee. Ook bij kleinere bedrijven is het nuttig, alleen moet je dan goed nagaan hoeveel bezoekers de beoogde pagina normaalgesproken trekt in een bepaalde periode. Daaruit kun je opmaken hoeveel pageviews nodig zijn.

Werk je als webredacteur bij een klein bedrijf en wil je een A/B-test uitvoeren? Stel dan vooraf een geschikte doorlooptijd vast, en een passend volume. En, misschien nog wel het beste advies, houd je daaraan. Test niet te kort, zodat er geen periodieke invloeden zijn die je niet kunt veranderen. Bij een test die je een week of twee laat staan is het risico op een onbetrouwbaar resultaat een stuk kleiner (en bij herhaling zelfs vrijwel nihil).

Wat praktische hulpmiddelen:

- Vwo.com heeft een goede tool om je te helpen met het berekenen van de duur van je test. Kijk maar eens op hun site.

- Measuringusability.com geeft tips over het volume dat je test moet bereiken. Kijk maar eens naar punt 7.

Over de auteur: Fleur Gorissen-De Paauw

Online communicatie biedt ongekende mogelijkheden je content optimaal in te zetten. Als online specialist bij Presenter schrijf, analyseer en optimaliseer ik krachtige content voor verschillende klanten. Ik blog over mijn ervaringen.

De wijze waarop zelflerende optimalisaties worden ge”bust” is een beetje kort door de bocht.

Het ligt er maar helemaal aan hoe je zelflerende optimalisatie werkt. Als dit gedaan wordt op basis van een voortdurend berekende significantie, dan is introduceert dit zoals hierboven beschreven wordt inderdaad de kans op de verkeerde conclusies.

Een goed zelflerend optimalisatie algoritme echter trekt nooit direct een definitieve conclusie, maar houdt juist rekening met de grilligheid van het verloop en zal daarom niet zo maar een definitieve conclusie trekken en de “verkeerde” variant uitserveren. Zogenaamde “multi-armed-bandit” algoritmes zijn juist ontworpen om het verlies in de test te beperken en het is wiskundig te berekenen dat aan het einde van een significante periode het zelflerend algoritme altijd minder verlies opgeleverd heeft dan een klassieke A/B test. Het is wel mogelijk, zeker bij grillig verloop, dat het zelflerende algoritme een langere tijd nodig heeft om dezelfde mate van significantie te bereiken, maar dan wel met minder verlies.

Het zijn gewoon twee verschillende aanpakken met elk een eigen doel. A/B test (mits goed uitgevoerd) is beter in het sneller bereiken van een hogere significantie, maar het multi-armed bandit algoritme is beter in het beperken van het testverlies.

Dankjewel Roger. Goede toevoeging!